链接点击:https://mp.weixin.qq.com/s/M_cS9emL-qXZR8zLtVSDvg

在农业现代化进程中,智能水果采摘的重要性日益凸显。水果检测与识别作为机器人采摘的关键环节,现有方法对单模态视觉数据的依赖性强,存在通用性不足,难以适应复杂环境和处理新水果品种等问题,导致图像特征与上下文理解之间存在语义鸿沟。

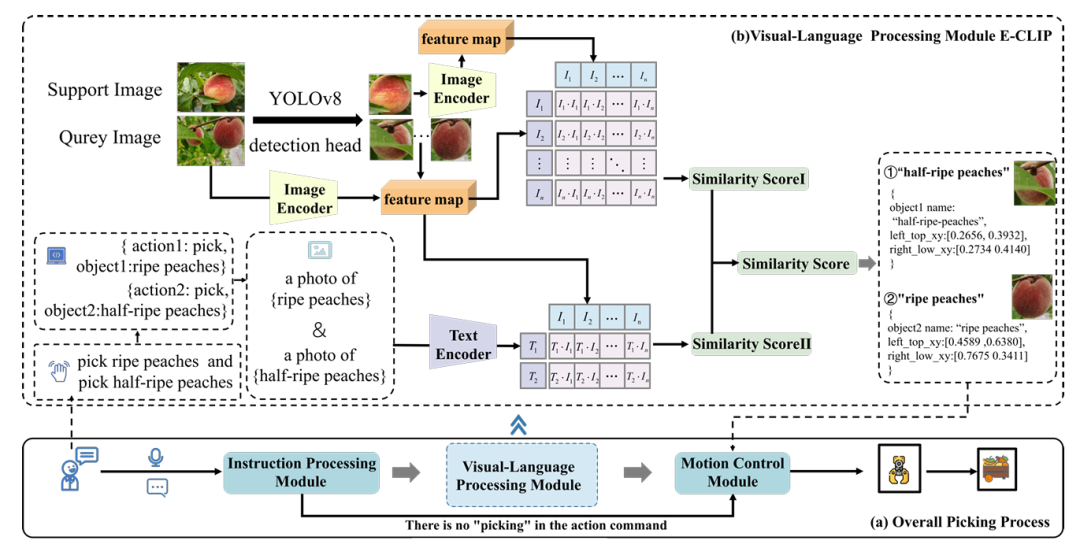

华中农业大学研究团队提出了一种基于视觉语言模型(VLMs)的多模态水果检测与识别框架 ——E-CLIP(Enhanced CLIP-Based Visual Language Model)。该框架通过整合多模态信息,增强了在不同环境条件和水果类型下的鲁棒性和泛化能力,同时支持自然语言指令输入,促进了人机交互。

-

-

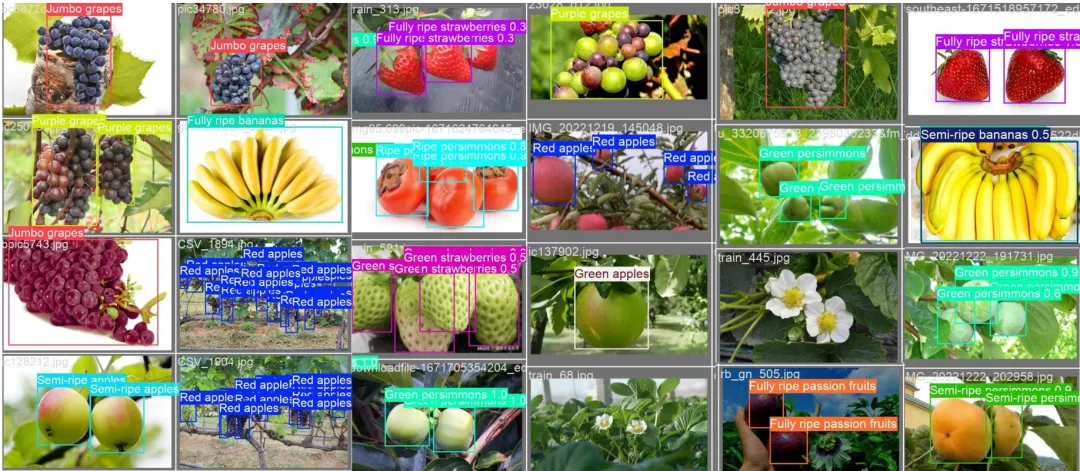

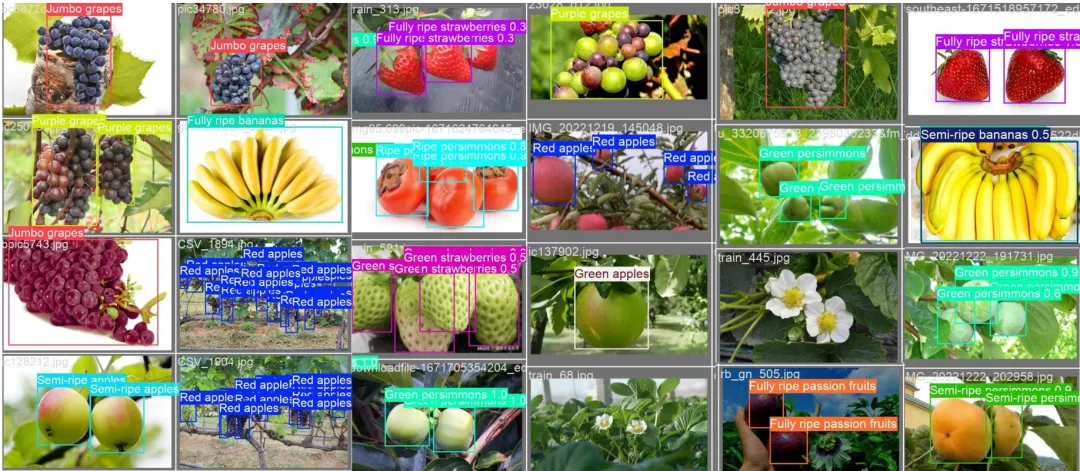

包含 12 个水果类别、6770 张真实果园图像,其中 7 类标注了未成熟、半成熟、成熟三个成熟度等级。

-

利用 Qwen-7B 生成 100 条自然语言查询,建立视觉特征与文本描述的语义对齐,支持细粒度成熟度检测和开放集识别。

-

-

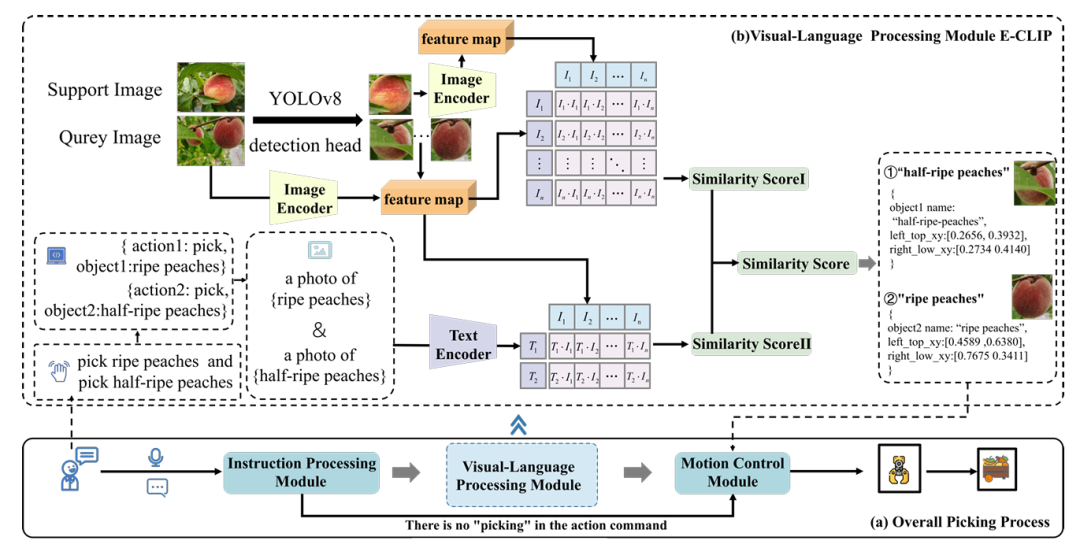

开发自然语言指令输入模块,结合语言模型解析器,使机器人能根据文本或语音命令执行复杂任务,降低了农业机器人的技术门槛。

-

-

YOLO 检测头:用于检测图像中的水果区域,输出精确的边界框坐标,为后续分类提供定位基础。

-

图像 - 图像对比学习分支:通过对比不同水果图像的相似性,提升模型在数据稀缺和复杂环境中的识别能力。

-

图像 - 文本对比学习分支:将结构化自然语言指令与图像对比,学习指令与水果特征的关系,增强模型对任务需求的理解和零样本场景下的泛化能力。

-

在标准测试集上,E-CLIP 实现了F1 分数 0.752和mAP@0.5 0.791的优异成绩,显著优于传统单模态模型(如 YOLO 系列)和其他多模态模型(如 GLIP、RegionCLIP)。

-

在遮挡和光照变化的极端条件下,E-CLIP 表现出更强的稳定性。例如,在严重遮挡和背光场景中,其 mAP@0.5 仍达到0.551,远超 YOLOv8 的0.505。

-

少样本学习:使用 16 个样本训练时,mAP@0.5 达到0.646,接近全数据集训练结果。

-

零样本学习:对未训练的新水果类别(如橙子、西瓜等),mAP@0.5 为0.626,展现出对新类别的适应性。

-

推理速度达54.82 FPS,平衡了速度与精度,适合在资源受限的边缘设备上部署,满足农业机器人实时作业需求。

E-CLIP 为水果检测与识别提供了新的技术路径,其多模态学习能力和自然语言交互特性有望推动智能采摘机器人向通用化、智能化发展,提升农业生产效率并降低人力成本。随着技术的不断优化,多模态 AI 有望在未来农业自动化中发挥更关键的作用,助力实现 “精准农业” 和 “智能农业” 的目标。

作者团队:华中农业大学信息学院、植物科学技术学院等单位联合研究成果原文链接:Agriculture 2025, 15, 1173

未农智能面向智能育种及智慧农业发展需求,是一家综合应用生物技术、信息技术、机器人技术、物联网技术和智能装备赋能未来农业发展的机器人公司。公司为植物无损感知和高通量表型检测提供关键技术、核心模块、整机装备和检测服务,提供实现电脑强化人脑、机器替代人力的农业数据获取及解析整体解决方案,保障国家种业安全,服务未来农业发展。

未农智能目前已有未农智“研”、未农智“产”、未农智“教”三个产品系列,产品覆盖大田、设施等多个场景,可执行移动搬运、精准灌溉、设施巡检、表型采集等多项农业作业任务。